01 ȫ��AI�O��څ��

ȫ���ȣ�AI���_�l��ʹ�����ڼ��١������ƶ������ܼ��_չ�������Դ_��AI����һ�����w�����M����ս��������Ŀ�˵�ͬ�r���������L�U����ȫ��AI�O�ܱ��F�������������څ�ݡ�

څ��һ����OECD��AIԭ�t���������ƶ��Ļ���

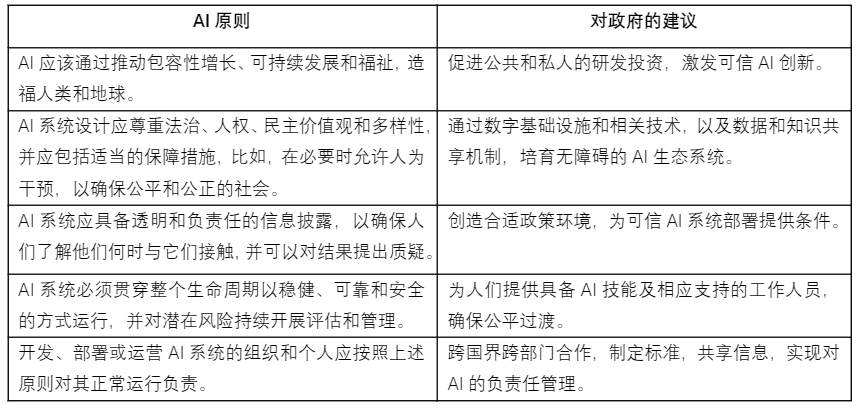

OECD��G20��2019��ͨ�^��AIԭ�t���ɞ������ͽM���������˞鱾�Ŀ���AI������ȫ����ʡ��@Щԭ�t��2016���_ʼ�����PAIʹ�Ñ���ѭ�ĺ��ĵ���ԭ�t�Ĺ��_ӑՓ֮���ƶ���ԭ�t���w���T��_��AI�ĺ�̎������V��������AI���Ɖ��T�籣�o�˙��������ϴ�ʩ���Լ�ʹ��AI�ĽM���Ƿ��ѽ����m���������͆�؟�ƶȵȷ��档�±���OECD��AIԭ�t���䌦���������ƶ��Ľ��h��

���磬�W�˵�AI����Ҫ���cOECD�Ć�؟��AI�Ľ�ȫ����ȫʹ��ԭ�tһ�£�����OECDԭ�t���A�ϸ��Mһ����ָ����AI���õġ��t������������ֹʹ��AI�M�л�������О��������������u�ֵđ��á��M���҇�����OECD���ң���OECDԭ�t������҇��ڃȵ�G20�����I������2019��6�±�����G20 AIԭ�t�ṩ�˻��A��

څ�ݶ�����ȡ�����L�U��AI�����ƶ�����

��������ע�ڌ�AIԭ�t���T���`�����õķ�������Ըָ����������Ҏ�t���ȣ������ڌ�������L�U��AI������2023��4�£�G7�Ĕ��ֻ��ͼ��g���L���_�˽yһAI���^�c������������AI��ӎ������L�U�ƶ����{�����P���ߺͷ�Ҏ���ڹĄ�ؓ؟�ε�AI�lչʹ�úͽ���AI�L�U֮�g�ҵ�ƽ�⡣�@�N����ʹ�������ƶ��߿��Ը���푑����ٰlչ��AI���¡�

���@һ����ָ���£�2023��10��30�գ�G7���ң����ô�����������������ձ���Ӣ���������͚W�ˣ���AI���Hָ��ԭ�t��AI�_�l�ˆT�О�ʄt�_�Ʌf�h���@һ�e�댦���Ƅ���������ȫ��f�{һ�µĻ����L�U�Ŀ�ܣ��Դ��MAIϵ�yؓ؟�κͰ�ȫ�_�l��ʹ�����P��Ҫ������W�˺ͼ��ô��AI�����͔�����������ʹ���L�U��Ӱ��u����AIϵ�y�w�벻ͬ�ĺ�Ҏ�x��e����V���ĺ�ҎҪ���m���ڱ��w���L�U��ϵ�y�������L�UAIϵ�y�t�������L�Uˮƽ�M���^��Ҫ��

څ�������^�e�ИIͨ�ú��ض��ɷ��������ƶ��p��AI�O������

AI���g��ijЩ�ИI��ʹ�ÿ����������L�U�����磬���ڰ�ȫ�L�U�ߣ���Ҫ�~����ИI�ض�ָ����Ҏ�t�������ڹ�·�ϵ��Ԅ��{���܇�����y��ʹ��AI���O�ܙC����Ҫ�ƶ��ض�Ҏ�t������С��AI�����M���J��ɵĝ����L�U�����磬��ƫҊ�ijб������y�еİ�ȫ����ɵ��L�U��

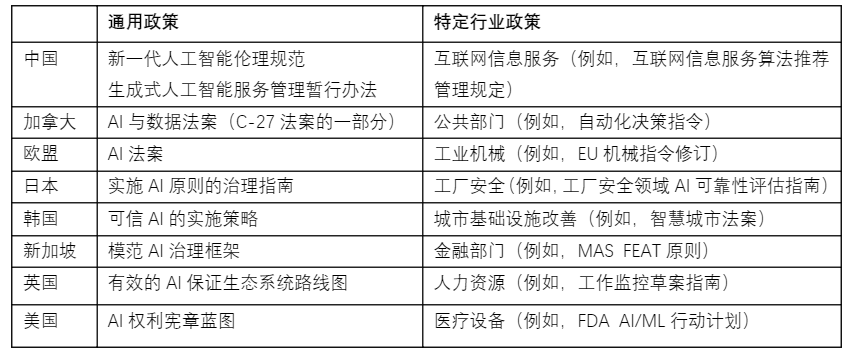

�҇���ȫ��������^�e�ИIͨ�ú��ض������ƶ��p��AI�O�����ߣ����ИI���������Ļ�����ܣ���oՓ���Ă��ИI�_�l��ʹ��AI�������ṩ�����ı��o��ʩ���ИI�ض������t���Q���w�ИI�L�U����AIʹ���ƶ����~���ָ����ᘡ��±��Ǹ���ͨ�ú��ض��ИI�p��AI�O�������e����

څ���ġ��ƶ����{��AI���PӰ��I�������

AIҎ�t��ͬ�r��Ӱ푺��ƄӔ������Йࡢ�������ݡ��W�j��ȫ�͔��փ������ӵ����P�I�������ߵ��ƶ������茦�F�������M���µĽ�ጡ�2024��5�£��W��������ʽͨ�^ȫ���һ����AI��������������AIӰ��I���ȡ����ȫ��ķ������������I���ƶ��µķ�Ҏ�����磬��ͨ�Ô������o�l����Ҏ���˽�QAI���Ԅӻ��Q����ʹ�Â��˔����������������Ҏ�t��������������Ҏ���������ИI����AI���蔵���Ĺ�ƽ�@ȡ��ʹ��Ҏ�t�������ַ��շ������������PAI�����ھ������L���ͷְl��Ҏ�����Լ����W�j���Է������t�������µı��ϴ�ʩ���Ա��o���M�ߺ���I����������s��AI�ӾW�j���{���ֺ���

څ���塢����AIɳ���_չ�O�ܜyԇ

ɳ�����S���ܱO�ܵĭh�����M�м��g���yԇ����ˣ�AIɳ�п��Ԏ����ƶ�ᘌ���AI��Ҏ���Ƅ��L�UͶ�Y�����M���������Ą�O�ܙC���c���c��˾�M�и��Ü�ͨ����2014��Ӣ�������О�O�ܾ֣�UK FCA�������O��ɳ�к����мs40��˾����ݠ�^���ò��������@һ���ߡ�

ĿǰUK FCA���ڜyԇ���ڿƼ��I���AIϵ�y����Ӣ����Ϣ���T�k���ң�ICO�����ڌ�AI�M�Д����[˽�yԇ���ښW�˺��¼��£��O�ܙC������ʹ��AI�O��ɳ�н�QAI���ٰlչ�������팦AI���gȱ�������p�����𡣴��⣬�����������͵�Ҳ�ڽ���AIɳ�У���W�˵�AI������ʩ���ʂ䡣

څ������AI������ȫ��������^��������

2023��ȫ�꣬���S������������ʽAIϵ�y�_�l�Ͱl�����Pע�������أ�����ȫ��AI��ͬ�����ͱO�ܻ��A�Ĺ��RҲ���������������Ї��ڃȵ�28���c������ͬ�_�ɵġ����R�������ԡ�����ȫ��AI��ȫ�����ʽ�l�����@��ȫ���һ��ᘌ�AI�@һ�������d���g�ć��H�����������������Ҫͨ�^�µ�ȫ��ͬŬ��������ͼ��w���흓���L�U���Դ_��AI��ȫ��ؓ؟�εķ�ʽ�_�l�Ͳ����츣ȫ����^�����@Щ���hҪ��ȫ�������ͬ�挦AI��ȫ�������������ȏ��s����ͨ�^�f�{���H푑��ͱ��ϴ�ʩ�C�ƣ����MAI������ȫ����������⣬��OECD��AI���������M���W��ί�T��AIί�T����ȫ��AI����Pϵ���χ��C���ĸ��N���h���A�ϣ��ձ�G7��ϯ���l���ˡ��V�u����ʽAI�M�̡��� �l���P��AI���Hָ��ԭ�t��AI�_�l�ˆT���О�ʄt��

02 ��AI�����ƶ��Ć�ʾ

1.ȫ���J�RAI�ď��s��

���_���������Č��I֪�R�ƶ�AI���ߣ����_���ܱO�܌��w�������Č��I֪�R��Ч��ʩ�����ߡ��_�����@ȡ����I֪�R��Ҫһ���r�g��߀�漰�����Pָ������Ӗ�����̡��������O�����Լ��������С������茦ȫ��AI���B�M���L�hҎ������������Ͷ�����ó�ֵĜʂ䣬�����¼������h�T���h�a�N40�q�����¼����������M�n�ÌW��AI��

2.���_AI��Ҏ�ƶ��Ĵ_����

�ƶ�AI��Ҏ�r����Ҫ�^�eAI��AIϵ�y�����_Ҏ�t�ƶ�����D�DZO��AI���g���펧�����L�U�����磬��Ȼ�Z��̎�����沿�R�e�����ԣ�߀��AI���g��ʹ�÷�ʽ�����磬AI����Ƹ���̻�O���еđ��ã��������L�U��������I���f����Ҏ�Ĵ_�������P��Ҫ��߀����AI����һ�����w�M�бO�ܡ����_֪����ЩAIϵ�y���ڱO�ܵķ������Լ��Ȳ��L�U�����������c����������������I����AIҎ�t���M��O��������������

3.����ȫ��Ҏ����������Ҫ��

ȫ��AI������������ه��ȫ��AI��Ҏ�Ļ������ԣ�һ���棬�������Դ_��������Ҏ�߂�һ�µĿɱ��^����ЧҎ�t���A���ɜp�ٱO���������L�U������һ���棬�������Կɞ�ȫ���\�I��AI���յ����M���ṩͨ�ñ��o�������ܵ�AI����������֮�⣬��Ҏ��������߀���Դ��AI��˾���g�аl�����÷����ṩ���\�I�������ɱ���

4.��������������AI�{���L�U����

�����S�˾��ه������������AI�������ƶ�����Ҫ��������AI�{���L�U�����ͺ�ҎҪ����W�˵ġ�AI������������M����AI�����Ҏ������AIϵ�y���ṩ�ߡ����N�̡��M���̺��Ñ�Ҏ���������x�գ����������Ҙ˜��c���g�о�Ժ��NIST���ƶ��ġ�AI�L�U������ܡ��������AI�Ñ�ָ���փԣ��f��ͨ�^��������ُAI���Օr�迼�]���L�U�ͺ�ҎҪ��

��������

���

���lչ�о���

��������

����������26��ͨ���ИI�Ĕ��������������ھ�͔����ƌW��BI���I�Nһ�w��ƽ�_�ܘ��͘I��Ҏ�������P���I���`���о������ꌣע��I���ֻ��\�I�D�ͺ͔���Ҫ���Ј��о���